Как в кино

Само слово «дипфейк» пришло к нам из английского языка и переводится как «глубинная подделка, ложь». А если разбираться с технической стороной вопроса, то это аудиовизуальный контент, созданный нейронными сетями на основе уже существующих видео, фото и голосовых записей.Хотите конкретный пример? Пожалуйста. Три года назад хитом интернета стало «рождественское видеопоздравление английской королевы». В кадре 94-летняя Елизавета II отплясывала на фоне сверкающих елок. Вышло забавно.

Другой случай — во время недавней прямой линии Владимиру Путину видеовопрос задал… Владимир Путин. Весьма реалистичный дипфейк создал студент из Санкт-Петербурга. Российский лидер отметил находчивость парня…

Любители смотреть кино в интернете наверняка уже привыкли к тому, что перед началом фильма часто появляется реклама с участием дипфейкового Джейсона Стетхема. Раньше в сети были популярны подобные ролики с Брюсом Уиллисом, Томом Крузом, Киану Ривзом.

Однако далеко не всегда продукт нейросетей вызывает улыбку. Все чаще технологию дипфейков стали использовать преступники. Так, в январе в социальных сетях активно распространялась реклама, где Григорий Азаренок, сидя в студии СТВ, «лично гарантировал белорусам возможность успешного заработка на инвестиционной платформе «Газпрома». Вот только сам телеведущий в личных аккаунтах поспешил заявить, что его личность используют кибермошенники. В ОАО «Газпром трансгаз Беларусь» тоже опровергли причастность к созданию «инвестиционной платформы». Но, увы, нашлись доверчивые граждане, которые поверили в фальшивку и перевели деньги на счета преступников.

Создать дипфейк с использованием медийной личности (актера, политика, телеведущего) довольно просто, так как интернет наполнен огромным количеством исходных данных — фотографиями, видео- и аудиоконтентом. Но даже обычные люди могут стать прообразом для подложного контента: пара снимков и роликов из соцсетей, голосовые сообщения из общего чата — и поддельная цифровая личность готова.

Нередко в социальных сетях становятся популярными дипфейки с Александром Лукашенко. Президент признавался, что лично видел некоторые из них и был поражен сходством: «Там в уста могут вложить любую заразу. И люди будут думать: это наш Президент или не наш?» Вместе с тем Глава государства убежден, что развития искусственного интеллекта избежать не выйдет. Однако быть осторожными с ним и стремиться обезопасить себя мы просто обязаны.

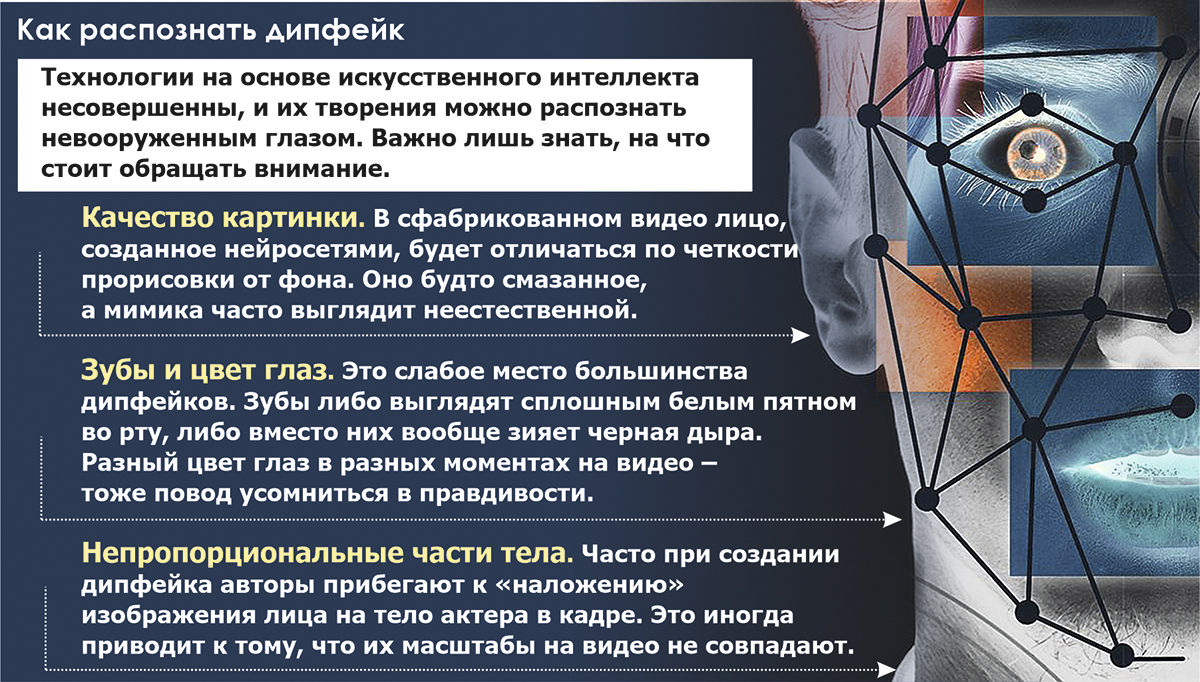

Повод для сомнений

Политолог Вадим Боровик обращает внимание: наши граждане должны понимать, что идет информационная война и на ее полях для некоторых участников «все средства хороши». Фейки и дипфейки — грязные методы, которые берут на вооружение и мелкие мошенники, и крупные игроки в мировой политике. Как не дать себя обмануть?— Первое и самое важное — правильно оценивайте источник информации, — подчеркивает политолог.

Безусловно, не стоит верить всему, что вы видите в социальных сетях. Ведь, по большому счету, там нет никаких фильтров для достоверности продвигаемой информации, а значит, и нет заслона для информационных вбросов.

— Другое дело — официальные источники. Например, зарегистрированные СМИ, которые на протяжении длительного времени формировали репутацию и предоставляют своей аудитории правдивые и объективные материалы. Или официальные аккаунты, сайты государственных органов, компаний и бизнес-структур, — говорит Вадим Боровик. — Если видите, что человек, которому вы доверяли (например, журналист или политик), вещает на непривычной для него онлайн-платформе, то это повод насторожиться.

Согласитесь, что если первое лицо государства захочет сделать заявление, то вряд ли выберет для этих целей YouTube-аккаунт со странным названием.

— Кроме того, важно обращать внимание на то, насколько информация, которую вы видите в интернете, соответствует сфере деятельности того или иного человека. Президенты или политические журналисты вряд ли будут рекламировать инвестиционные платформы. Это просто не их профиль, — подмечает Вадим Боровик. — И уж тем более они не будут призывать людей предпринимать какие-то действия финансового или юридического характера.

К источникам информации, по словам политолога, нужно подходить так, как к выбору продуктов питания:

— В магазине вы наверняка покупаете молоко или мясо тех производителей, которые давно зарекомендовали себя. Сомнительная упаковка или недостоверная информация на ней — всегда повод отказаться от покупки. Так же следует поступать и с источниками информации: не доверяйте видеороликам или новостям, которые возникают не пойми откуда. Есть сомнения? Ищите подтверждение или опровержение в проверенных источниках.

Постправда на заказ

Важна цифровая гигиена, считает Вадим Боровик:— Мы привыкли чистить зубы и умываться по утрам. Нужно привыкать перепроверять новости, которые вызывают у нас сомнения.

Двести лет назад информация могла доходить до общественности неделями, сто лет назад — днями, а теперь — пара секунд, и все уже обсуждают очередной инфоповод. Причем электоральные кампании — это период, когда количество вбросов возрастает в разы. Раскачать обстановку в стране накануне важного политического события — кому это выгодно?

— Те, кто живет в Беларуси, кто растит тут своих детей, имеет бизнес, планирует встречать старость, — эти люди больше всего заинтересованы в стабильном развитии страны, и потрясения им не нужны. Другое дело — те, кто находится за рубежом, — подчеркивает политолог. — Беглые, штампуя фейки про наше государство, порой таким образом пытаются оправдать свой отъезд. Ведь, по их логике, если они уехали отсюда, значит, «здесь не может и не должно быть хорошо»…

Как отмечается в отчете экспертов Всемирного экономического форума, созданные искусственным интеллектом дипфейковые видео- или аудиозаписи могут использоваться для распространения ложной информации о кандидатах или манипулирования общественным мнением. Авторы даже приводят конкретный пример: в сентябре 2023 года во время выборов в Словакии стало популярным аудио, из которого следовало, что один из кандидатов якобы обсуждал с представителем СМИ, как проводить манипуляции. Репутация была подпорчена, хотя позже выяснилось, что это сфабрикованная подделка.

— Если в сети начинает распространяться информация, порочащая того или иного чиновника, политика или журналиста, которому вы привыкли доверять, да еще и через сомнительные источники, не спешите этому верить. Лучше попытайтесь взглянуть на ситуацию трезво. Может, источник в этом случае преследует какие-то свои цели? — обращает внимание Вадим Боровик. — Долгое время одно СМИ распространяло недостоверную информацию в отношении меня. Буквально вырывались отдельные фразы из моих выступлений и подавались на сайте так, как было выгодно авторам текстов. Впоследствии это же СМИ неоднократно пыталось вмешаться в проведение электоральной кампании в 2020-м и повлиять на ее результаты. Чем все это закончилось? Отдельные сотрудники редакции отбывают наказание в местах не столь отдаленных.

Политолог предупреждает, что создание и распространение фейков и дипфейков, чтобы оклеветать кого-либо или сорвать выборы, может закончиться печально. Белорусское законодательство в этом отношении весьма строгое.

kurak@sb.by